Rede neural artificial aprende palavras, imagens e música

Com informações de June Namioka - IBM - 24/09/2015

[Imagem: Osogami/Otsuka]

Redes neurais artificiais

Redes neurais artificiais têm sido estudadas com a esperança de criar máquinas - programas de computador - com uma capacidade de aprender similar à humana.

Uma rede neural biológica é complexa demais para ser mapeada exatamente em uma rede neural artificial, mas Takayuki Osogami e Makoto Otsuka, da IBM Research de Tóquio, deram alguns passos importantes.

Os dois desenvolveram neurônios artificiais que imitam matematicamente um modelo de aprendizagem cerebral para aprender palavras, imagens e até música - o modelo é conhecido como "plasticidade cerebral dependente dos tempos de disparo".

Os neurônios matemáticos de Takayuki e Makoto formam um tipo de rede neural artificial estocástica que define uma máquina de Boltzmann dinâmica (DyBM), um sistema capaz de aprender sobre informações de vários contextos através do treinamento - a repetição que leva à perfeição, por assim dizer.

Ciência em bits

A dupla ensinou a palavra Science (ciência) a sete neurônios artificiais, um neurônio por bit, na forma de uma imagem bitmap. Assim, a imagem da palavra Science tornou-se:

01000010010010010000100010100101000

01000010000010010000110010100001000

00110010000010011100101010100001110

00001010000010010000100110100001000

00001010010010010000100010100101000

01110001100111011110100010011001111

Os "1s" representam as linhas que compõem as letras, enquanto os "0s" traduzem os espaços em branco em torno das letras.

O que esses sete neurônios aprenderam foi ler e gravar informações de 7 bits em uma única tacada. A palavra Science é expressa na forma de sequências de 7 x 35 bits que equivalem a uma imagem bitmap monocromática de 245 bits. Os sete neurônios leem e memorizam cada pedaço de 7 bits de informação na imagem.

Por exemplo, "0100010" é a décima coluna da imagem total de acordo com a ordem de aprendizado, e os neurônios lembram esses pedaços na ordem em que aprenderam. Ao memorizar a palavra da esquerda para a direita e da direita para a esquerda, os neurônios conseguem reconhecer "ciência" para a frente, para trás ou em qualquer ordem - como fazemos ao resolver um jogo de palavras embaralhadas.

Mais neurônios, mais memória

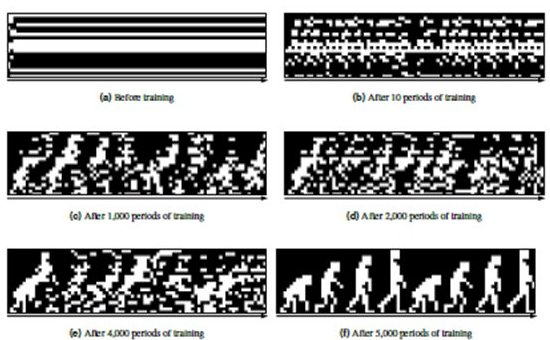

As coisas ficam mais complicadas, e mais interessantes, quando esses neurônios artificiais aprendem sobre diferentes temas em diferentes formatos, tais como a imagem da evolução humana.

Desta vez, 20 neurônios artificiais foram incumbidos da tarefa de aprender esta imagem, que mostra como nós evoluímos, da esquerda para a direita. Por que usar 20 neurônios artificiais desta vez? Porque uma coluna da imagem que mostra a evolução humana consiste de 20 bits.

[Imagem: Osogami/Otsuka]

Os neurônios aprenderam as partes da imagem alinhadas na ordem correta de evolução - dos macacos ao Homo sapiens. Rodando a simulação, os neurônios foram aprendendo mais ao longo do tempo, detectando os erros e repetindo as simulações. Foram necessários apenas 19 segundos para os 20 neurônios aprenderem a imagem corretamente.

Para aprender a compor uma música - foi usada uma música tradicional alemã chamada Ich bin ein Musikante - a partir das notas musicais, foram necessários 12 neurônios e 900.000 rodadas da simulação, o que levou 28 minutos no mesmo computador.

Máquina de Boltzmann dinâmica

A máquina de Boltzmann dinâmica de Takayuki e Makoto não consegue apenas memorizar e recordar padrões sequenciais. Ela pode também detectar anomalias em padrões sequenciais e fazer previsões sobre padrões futuros.

Assim, a rede neural artificial pode ser usada para prever riscos de condução assumidos pelos motoristas a partir de dados coletados por câmeras montadas no carro. Ou compor novas músicas, até atender ao gosto do freguês, ou mesmo detectar e corrigir erros gramaticais em textos.

A dupla pretende a seguir integrar sua máquina de Boltzmann dinâmica a técnicas de aprendizagem por reforço para obter comportamentos otimizados de detecção de anomalias e cálculo de previsões.

Artigo: Seven neurons memorizing sequences of alphabetical images via spike-timing dependent plasticity

Autores: Takayuki Osogami, Makoto Otsuka

Revista: Nature Scientific Reports

Vol.: 5, Article number: 14149

DOI: 10.1038/SREP14149

Detector inédito vai capturar partículas que não interagem com quase nada

Este experimento irá dizer se a gravidade obedece a mecânica quântica

Película transparente esfria o carro sem gastar bateria ou combustível

Rede de lasers viabiliza exploração da Lua com energia solar

Gerador inédito produz eletricidade consumindo gases de efeito estufa

Estado exótico da matéria é criado com luz dentro de um chip

Luz manipula a matéria de maneiras inesperadas

Serragem de madeira é transformada em material resistente ao fogo

Calor amolece metais, mas muito calor torna metais muito mais fortes

Material tem rigidez alterada remotamente por ondas sonoras

Materiais inertes aprendem a mudar de forma e se movimentam

Nova técnica holográfica guarda dados em três dimensões da luz

Semicondutor usa hidrogênio para imitar o cérebro

Computador termodinâmico se alimenta do ruído e do calor

Chip que imita o cérebro faz computação espaço-temporal

Minicérebros vivos são treinados para resolver tarefas de engenharia

Todos os direitos reservados.

É proibida a reprodução total ou parcial, por qualquer meio, sem prévia autorização por escrito.