Rede neural vai adivinhar palavra antes que você fale

Redação do Site Inovação Tecnológica - 10/01/2018

[Imagem: Chao Du et al. - 10.1038/s41467-017-02337-y]

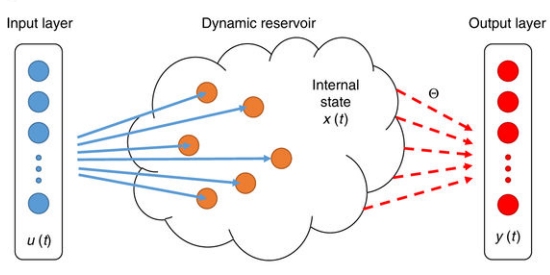

Rede neural de memoristores

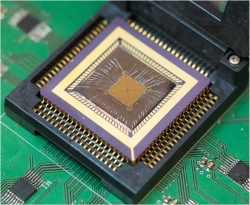

As redes neurais feita com memoristores - componentes eletrônicos que retêm uma memória do que lhes ocorreu anteriormente - prometem melhorar dramaticamente a eficiência do aprendizado de máquina, da inteligência artificial e dos computadores neuromórficos, que trabalham de forma mais parecida com o cérebro humano.

Uma demonstração de que isso está mais perto da realidade do que se imagina acaba de ser dada por Chao Du e seus colegas da Universidade de Michigan, nos EUA.

Eles construíram uma rede neural em hardware, chamada "sistema de computação de reservatórios", que consegue prever palavras e números que virão a seguir em um texto escrito - e o próximo passo será prever palavras antes que elas sejam ditas durante a conversação normal entre duas pessoas.

A computação de reservatório é um conceito no qual as informações sobre um sistema são inseridas em uma rede neural artificial especial em tempo real, para que o modelo se altere dinamicamente e, assim, se adapte ao ambiente.

Sistemas desse tipo, que melhoram a capacidade de uma rede neural típica e reduzem o tempo de treinamento necessário, já foram criados no passado usando componentes ópticos grandes. Usar memoristores, componentes que podem ser fabricados em nanoescala, significa que o sistema pode ser facilmente integrado nos chips eletrônicos atuais com o mesmo nível de miniaturização.

Rede neural de reservatório

Inspiradas no cérebro, as redes neurais são compostas por neurônios, ou nós, e sinapses, as conexões entre os nós.

Para treinar uma rede neural para que ela execute uma tarefa, a rede é submetida a um grande número de questões e as respectivas respostas a essas questões. Uma vez treinada, uma rede neural pode então responder perguntas para as quais ela não sabe a resposta de antemão - por exemplo, identificar um rosto humano em uma imagem.

Os sistemas de computação de reservatórios construídos com memoristores, no entanto, podem dispensar a maior parte do processo de treinamento porque o componente mais crítico do sistema - o reservatório - não requer treinamento.

Quando um conjunto de dados é inserido no reservatório, o próprio reservatório identifica características relevantes nos dados e as entrega em um formato mais simples para uma segunda rede. Esta segunda rede só precisa de treinamento como as redes neuronais mais simples, alterando os pesos das características que a primeira rede lhe passou até atingir um nível aceitável de erro.

[Imagem: Chao Du et al. - 10.1038/s41467-017-02337-y]

Previsão de conversas

As vantagens desse aprendizado simplificado são tão mais significativas quanto mais complicada é a tarefa a ser executada. Por exemplo, identificar um rosto em uma imagem é uma tarefa relativamente fácil, enquanto aprender como uma pessoa entabula uma conversa real é muito mais complexo porque as variações são radicais e imensamente mais variadas.

Usando apenas 88 memoristores, a equipe conseguiu treinar a rede neural para que ela identificasse numerais escritos a mão com 91% de precisão.

O próximo passo será prever não palavras escritas, mas faladas. "Nós podemos fazer predições em linguagem falada natural, de forma que você não precisa falar a palavra toda. Nós podemos na verdade predizer o que você planeja dizer a seguir," garante o professor Wei Lu.

Enquanto construir um tradutor simultâneo é ainda um sonho para um futuro distante, os pesquisadores planejam usar sua rede neural para filtrar ruídos em sinais de telecomunicações, como a estática em transmissões de rádio, produzindo um fluxo mais limpo de dados. "Ela poderá também predizer e gerar um sinal de saída mesmo se o sinal de entrada for interrompido," prometeu Lu.

Artigo: Reservoir computing using dynamic memristors for temporal information processing

Autores: Chao Du, Fuxi Cai, Mohammed A. Zidan, Wen Ma, Seung Hwan Lee, Wei D. Lu

Revista: Nature Communications

Vol.: 8, Article number: 2204

DOI: 10.1038/s41467-017-02337-y

Processador biológico-eletrônico usa células cerebrais vivas para computação

Película transparente esfria o carro sem gastar bateria ou combustível

Esta bomba bombeia sem motor, sem barulho e sem lubrificante

Luz manipula a matéria de maneiras inesperadas

Medimos a força da gravidade de novo. E o resultado não bateu

Material tem rigidez alterada remotamente por ondas sonoras

Detector inédito vai capturar partículas que não interagem com quase nada

Potência dos lasers é multiplicada por espelho de plasma

Astrônomos encontram fronteira final da formação de estrelas na Via Láctea

O tempo é contínuo ou discreto? Relógios atômicos vão responder

Como criar robôs inteligentes como os da ficção científica?

Materiais inertes aprendem a mudar de forma e se movimentam

Nova técnica holográfica guarda dados em três dimensões da luz

Semicondutor usa hidrogênio para imitar o cérebro

Computador termodinâmico se alimenta do ruído e do calor

Chip que imita o cérebro faz computação espaço-temporal

Todos os direitos reservados.

É proibida a reprodução total ou parcial, por qualquer meio, sem prévia autorização por escrito.