Por que precisamos parar os robôs militares assassinos?

Da New Scientist - 24/05/2013

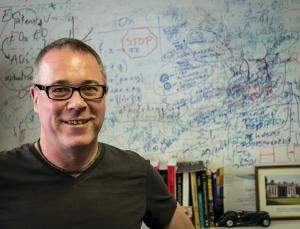

[Imagem: Will Hutchinson]

O especialista em inteligência artificial, Mark Bishop, afirma que está na hora de banir a fabricação de armas que possam ser lançadas ou causar destruição sem a intervenção humana.

Nesta entrevista, ele explica porque e porque robôs matadores são uma ameaça real.

O que é a campanha Pare com os Robôs Assassinos?

É uma confederação de organizações não-governamentais e grupos de pressão agindo em defesa da proibição da produção e uso de sistemas de armas totalmente autônomos - aqueles nos quais é eliminada a capacidade de um ser humano tanto para escolher o alvo preciso, quanto para intervir na decisão final de atacar.

Quão perto estamos disso?

Já existem exemplos. Alguns, como o sistema de armas Phalanx, usado na maioria dos navios da Marinha dos EUA para detectar e atacar ameaças automaticamente, existem já há algum tempo.

Outro é o israelense Harpia, um veículo aéreo não tripulado do tipo "atire-e-esqueça", que vai procurar e destruir instalações de radar.

O que está impulsionando o desenvolvimento dessas tecnologias?

A atual estratégia militar ocidental se concentra mais nos drones do que nas forças tradicionais, mas drones controlados remotamente são vulneráveis ao sequestro. Sistemas totalmente autônomos são praticamente imunes a isso.

Eles também custam menos. Isso significa que os fabricantes vendem mais, então há um imperativo comercial para o desenvolvimento de sistemas autônomos e para que os governos os adotem.

Quais são os perigos?

Há razões para duvidar que sistemas autônomos possam julgar adequadamente a necessidade de lutar, reagir a ameaças de forma proporcional ou discriminar de maneira confiável entre combatentes e civis.

Além disso, quando você coloca complexos sistemas de software interagindo, existe um enorme potencial para consequências imprevistas.

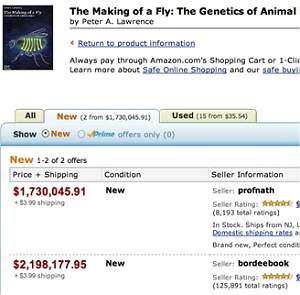

Um exemplo claro foi visto no site Amazon em 2011, quando agentes de software elevaram o preço de um livro para mais de US$ 23 milhões.

[Imagem: Divulgação]

Então, você está preocupado com a proliferação disso?

Sim. Na Coreia do Sul, os cientistas estão desenvolvendo um robô para patrulhar a fronteira com a Coreia do Norte. Se ele for adotado e se engajar em combate incorretamente ou desproporcionalmente, é fácil imaginar uma pequena incursão fronteiriça escalonando para se tornar um confronto sério.

Ainda mais assustadoramente, em 1983, durante exercícios militares dos EUA, sistemas de defesa automáticos russos detectaram falsamente um míssil, e apenas com a intervenção de um coronel russo se evitou uma guerra nuclear.

Mas o potencial de escalada fica particularmente assustador quando você tem sistemas autônomos interagindo com outros sistemas autônomos.

Os robôs não poderiam reduzir os riscos para os seres humanos?

Há um caso, apresentado por pessoas como o roboticista Ronald Arkin, em que os robôs podem fazer avaliações mais desapaixonados que soldados em sofrimento pela morte de companheiros ou em busca de vingança.

Isto não apenas não resolve o problema do escalonamento, como também ele se sustenta apenas se os sistemas puderem decidir quando se envolver de forma confiável, avaliando a proporcionalidade das ações e discriminando os alvos com precisão.

Então o que devemos fazer?

A tecnologia por trás dos sistemas autônomos tem outros usos, tais como o sistema de guiar carros do Google. Assim, o banimento do desenvolvimento seria difícil.

Em vez disso, devemos nos concentrar em um tratado global que proíba a utilização de armas autônomas.

Rede de lasers viabiliza exploração da Lua com energia solar

Estado exótico da matéria é criado com luz dentro de um chip

Luz manipula a matéria de maneiras inesperadas

Serragem de madeira é transformada em material resistente ao fogo

Medimos a força da gravidade de novo. E o resultado não bateu

Baterias de semente de girassol poderão alimentar nosso futuro

Material tem rigidez alterada remotamente por ondas sonoras

Calor amolece metais, mas muito calor torna metais muito mais fortes

Gerador inédito produz eletricidade consumindo gases de efeito estufa

Astrônomos encontram fronteira final da formação de estrelas na Via Láctea

Materiais inertes aprendem a mudar de forma e se movimentam

Nova técnica holográfica guarda dados em três dimensões da luz

Semicondutor usa hidrogênio para imitar o cérebro

Computador termodinâmico se alimenta do ruído e do calor

Chip que imita o cérebro faz computação espaço-temporal

Minicérebros vivos são treinados para resolver tarefas de engenharia

Todos os direitos reservados.

É proibida a reprodução total ou parcial, por qualquer meio, sem prévia autorização por escrito.